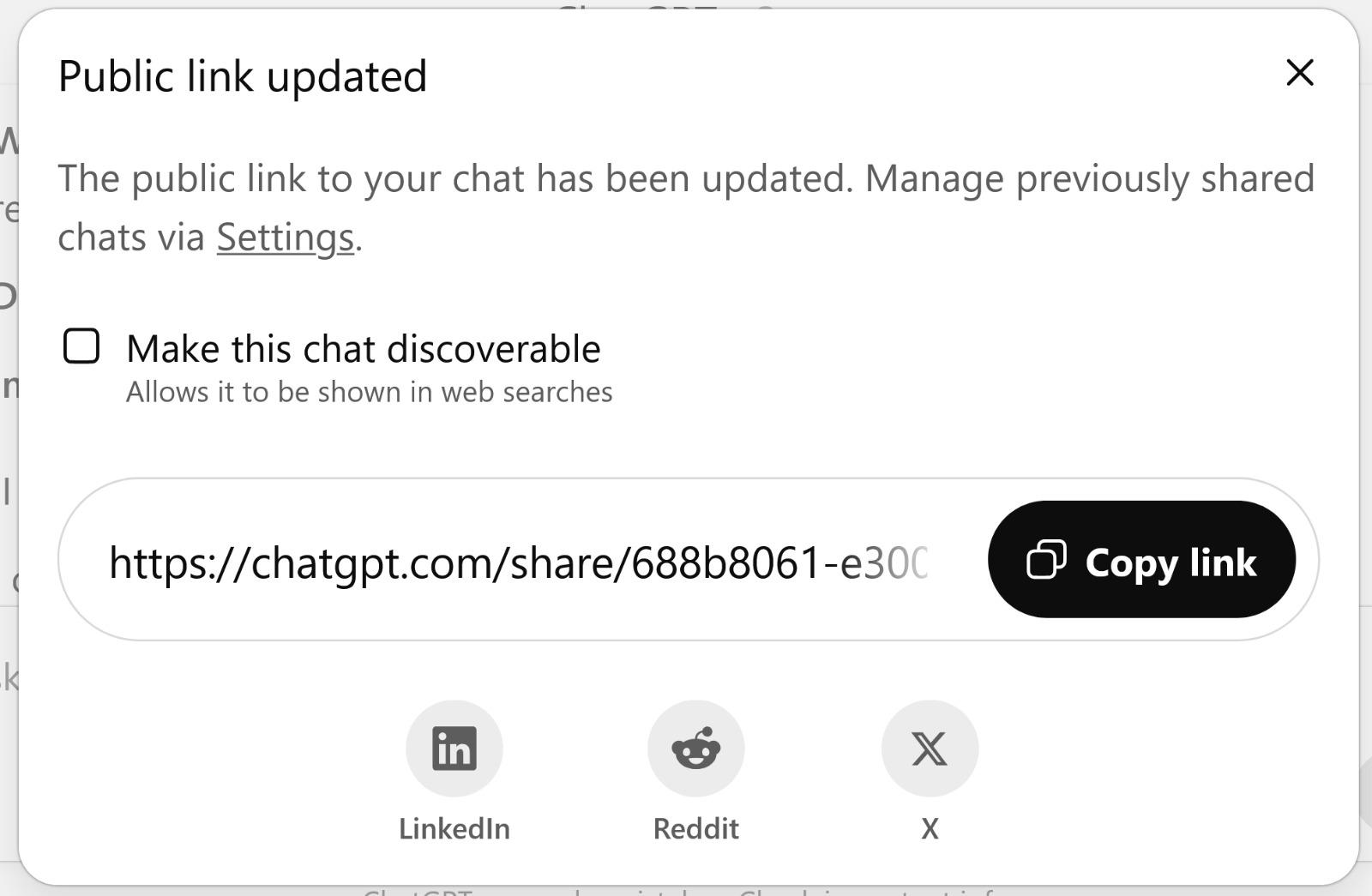

في عصر تتسارع فيه التكنولوجيا وتزداد فيه أدوات الذكاء الاصطناعي حضوراً في حياتنا اليومية، أصبح الحديث مع نماذج المحادثة مثل «ChatGPT» جزءاً من الروتين الرقمي للكثيرين. لكن ماذا لو علمت أن محادثاتك الخاصة مع هذه النماذج قد تظهر فجأة في نتائج البحث على جوجل؟ عنوان «أسرارك على المشاع» يشير إلى واقع جديد يثير تساؤلات حول الخصوصية والشفافية في عالم الذكاء الاصطناعي، حيث تتقاطع الحوارات الشخصية مع فضاء الإنترنت المفتوح. في هذا المقال، نستعرض كيف ولماذا تظهر هذه المحادثات في نتائج البحث، وما التداعيات المحتملة على المستخدمين والمجتمع الرقمي بصفة عامة.

أهمية خصوصية المحادثات مع الذكاء الاصطناعي في عصر البحث الرقمي

في عالم يتسارع فيه تبادل المعلومات، تتزايد أهمية حماية خصوصية المحادثات مع أدوات الذكاء الاصطناعي بشكل ملحوظ، خاصة مع تداول محادثات «ChatGPT» على نطاق واسع وظهورها في نتائج البحث على جوجل. هذا الأمر يثير تساؤلات جوهرية عن مدى أمان مشاركة المعلومات الشخصية أو المهنية خلال النقاشات الرقمية، وما إذا كان المستخدم يتخلى عن حقوقه بحسن نية أو من غير قصد. فالأخطار التي قد تنجم عن تسرب المعلومات لا تقتصر على اختراق الخصوصية فحسب، بل تمتد إلى تأثيرات محتملة على السمعة، الأمان الشخصي، وحتى المسائل القانونية.

لضمان التوازن بين الاستفادة من تقنيات الذكاء الاصطناعي والحفاظ على سلامة البيانات، يجب التفكير بعمق في كيفية إدارة الخصوصية. بعض النقاط التي يجب الانتباه إليها تتمثل في:

- التشفير وتأمين نقل المعلومات بين المستخدم والنظام.

- تفعيل آليات الامتثال لسياسات الخصوصية للمساعدة في حماية البيانات الحساسة.

- توعية المستخدمين بأهمية عدم مشاركة الأسرار أو المعلومات الحساسة على المنصات المفتوحة.

- تمكين المستخدم من التحكم الكامل في حقوق الوصول إلى محادثاته ومحتوياتها.

| المخاطر | التأثيرات | الإجراءات الوقائية |

|---|---|---|

| تسرب البيانات الشخصية | انتهاك الخصوصية، خسائر مالية | استخدام كلمات سر قوية، التحقق بخطوتين |

| ظهور المحادثات في نتائج البحث | تشويه السمعة، فقدان الثقة | مراجعة إعدادات الخصوصية بانتظام |

| استخدام البيانات لأغراض غير مصرح بها | استغلال المعلومات، مشاكل قانونية | التعاقد مع مزودي خدمات موثوقين |

كيف تظهر محادثات ChatGPT في نتائج البحث وما تعنيه للمستخدمين

في ظل تزايد الاعتماد على الذكاء الاصطناعي، أصبحت محادثات ChatGPT تظهر مباشرة في صفحات نتائج البحث على محركات جوجل، مما يفتح آفاقًا جديدة للمستخدمين للانتفاع بالمعلومات بشكل أسرع وأكثر دقة. هذه المحادثات ليست مجرد ردود آلية، بل هي خلاصة تحليلية مبنية على ملايين البيانات، تسمح للمستخدمين بالحصول على إجابات فورية وتحليلات متعمقة دون الحاجة للبحث في مصادر متعددة. يمكن رؤية المحادثات في شكل مقتطفات تظهر بشكل مبسط، مما يسهل عملية الفهم ويوفر الوقت.

تكشف هذه الظاهرة عن عدة مزايا وأسئلة للمستخدمين منها:

- تخصيص المحتوى: تظهر النتائج مبنية على سياق البحث بشكل أكثر دقة.

- مرونة التفاعل: إمكانية طرح أسئلة تتابعية مباشرة من خلال نتاج الذكاء الاصطناعي.

- حماية الخصوصية: ضرورة الانتباه إلى أن بعض المحادثات قد تُعرض بشكل عام، ما يثير تساؤلات حول سرية البيانات.

| الميزة | التأثير على المستخدم | التحدي المحتمل |

|---|---|---|

| الإجابات الفورية | توفير الوقت | احتمالية الاعتماد الزائد |

| فهم السياق | نتائج مخصصة | عدم الدقة في بعض الأحيان |

| مشاركة المحتوى | توسيع المعرفة الجماعية | مخاوف الخصوصية |

التحديات التقنية والقانونية لمشاركة المحتوى المولد آلياً عبر الإنترنت

مع انتشار أدوات الذكاء الاصطناعي وتوليد المحتوى بشكل متزايد عبر الإنترنت، ظهرت تحديات تقنية معقدة تتعلق بكيفية التعامل مع البيانات التي يتم إنتاجها تلقائياً. ليس فقط من حيث دقة المعلومات، بل أيضاً حماية الخصوصية وحفظ سرية المحادثات الشخصية، خاصة عندما تصبح هذه المحتويات متاحة للبحث في محركات البحث. فظهور محادثات مثل تلك التي تُجرى مع «ChatGPT» في نتائج البحث يثير تساؤلات حول مدى أمان المعلومات التي يتم تبادلها وما إذا كانت عرضة للاستخدام أو الاستغلال بطرق غير مرغوبة.

على الجانب القانوني، تتشابك الأمور أكثر مع غياب تشريعات واضحة تنظم حقوق الملكية الفكرية والأطراف المسؤولة عن المحتوى المولد آلياً. في كثير من الأحيان، لا تكون هناك معايير متفق عليها للتعامل مع محتوى قد يحتوي على معلومات شخصية أو حساسة. الجدول التالي يوضح أبرز التحديات التقنية والقانونية التي تواجه نشر هذا النوع من المحتوى:

| التحدي | التأثير |

|---|---|

| عدم وضوح الملكية الفكرية | صعوبة تحديد من يملك المحتوى وما هي حقوق الاستخدام |

| انتهاك الخصوصية | تسريب بيانات شخصية في نتائج البحث |

| عدم موثوقية المحتوى | انتشار معلومات غير دقيقة أو مضللة |

| غياب التشريعات الملائمة | فجوات قانونية تؤدي إلى صراعات قانونية محتملة |

- حماية البيانات: ضرورة اعتماد تقنيات أكثر تطوراً لضمان سرية المحادثات.

- الشفافية: توضيح مصدر المحتوى المولد إن كان بشرياً أم آلياً لتجنب التضليل.

- التشريعات الدولية: العمل على صياغة قوانين دولية تنظم حقوق النشر والخصوصية في الفضاء الرقمي.

استراتيجيات لحماية بيانات المستخدمين وتعزيز الخصوصية في تطبيقات الذكاء الاصطناعي

في عالم الذكاء الاصطناعي المتسارع، يبقى حماية البيانات الشخصية للمستخدمين من أبرز التحديات التي تواجه مطوري ومُشغلي التطبيقات. تتطلب هذه العمليات رؤية شمولية تجمع بين تقنيات التشفير الحديثة، وإجراءات التحقق متعددة العوامل، وإنشاء بنى تحتية رقمية تُراعي الخصوصية من التصميم. فالاعتماد على معايير مثل تجزئة البيانات وحفظها بشكل مشفر داخل النظام يضمن عدم استغلال المعلومات الحساسة، ويخفض من احتمالات التسريبات التي قد تهدد سمعة الشركات وثقة المستخدمين.

تتضمن الاستراتيجيات الفعالة أيضاً:

- تقييم دوريات للمخاطر: للكشف المبكر عن الثغرات وحماية التطبيق من الهجمات الإلكترونية.

- تقنية الخصوصية التفاضلية: التي تتيح استخدام البيانات الضخمة دون كشف هوية الأفراد.

- تحديثات أمان دورية: لضمان توافق تطبيقات الذكاء الاصطناعي مع أحدث المعايير العالمية.

- تبني سياسة واضحة للشفافية: تعزز الثقة بين المستخدمين والمطورين عبر إعلامهم بطريقة استخدام بياناتهم.

| الإجراء | الفائدة |

|---|---|

| تشفير البيانات على مستوى النهاية | حماية محتوى المحادثات من التسرب |

| آليات المصادقة متعددة العوامل | تقليل خطر الوصول غير المصرح به |

| سياسة حذف بيانات تلقائية | تقليل تراكم المخاطر مع الزمن |

Final Thoughts

في نهاية المطاف، تفتح ظاهرة ظهور محادثات «ChatGPT» في نتائج البحث على جوجل أبوابًا جديدة من التساؤلات حول الخصوصية والشفافية في عالم الذكاء الاصطناعي. بينما يندر أن تكون هذه المحادثات مجرد نصوص عابرة، فإنها تصبح قطعًا من البيانات التي يمكن أن تُعرض للعامة، مما يستدعي منا إعادة التفكير في كيفية التعامل مع المعلومات الشخصية والمحتوى الذي نشاركه عبر هذه الأدوات الذكية. تبقى القدرة على استخدام التقنية بحكمة وتوعية المستخدمين بأبعادها الحقيقية هي الخطوة الحاسمة لضمان مستقبل أكثر أمانًا ووضوحًا في رحلتنا الرقمية.